¿Por qué nos empeñamos en reducir la inteligencia artificial a un simple truco estadístico?

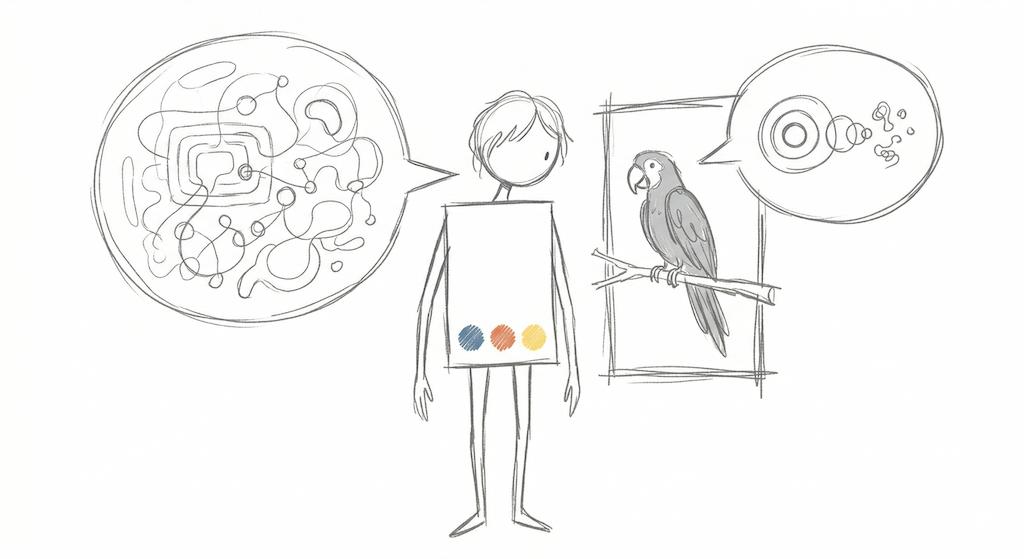

Cada vez que hablo de los grandes modelos de lenguaje, siempre hay alguien que me suelta la misma frase con tono condescendiente: “Agustín, no te engañes, solo son loros estocásticos. No piensan, solo escupen la palabra estadísticamente más probable”.

Y a ver, parcialmente tienen razón. Estos cacharros, que es como a mí me gusta llamarlos, funcionan calculando la probabilidad del siguiente token y haciendo una especie de sorteo para elegir la siguiente palabra. Hacen una distribución de probabilidad. Fin del misterio.

Pero quedarse con esa explicación es perderse lo verdaderamente importante.

La pregunta relevante no es cómo eligen la siguiente palabra, sino por qué, haciendo algo tan ridículamente simple, acaban teniendo el comportamiento que tienen. Sí, a veces alucinan y cometen errores tontos, pero la inmensa mayoría de las veces resuelven problemas complejos con una inteligencia que asusta.

A las personas nos cuesta aceptar que algo brillante pueda nacer de un sistema básico. Pero pensemos en nosotros mismos por un momento.

Coge una de tus neuronas. Una sola. Esa neurona no es inteligente. No tiene consciencia, no siente emociones, no sabe quién eres. Es más, si ahora mismo prescindes de una neurona, tú vas a seguir siendo exactamente el mismo. Sin embargo, cuando juntas miles de millones de esas neuronas “tontas”, de repente aparece una propiedad nueva. Algo que llamamos consciencia.

Como me recordaba el otro día mi amiga Silvia: yo ahora mismo estoy escribiendo este post sin tener ni puñetera idea de lo que están haciendo mis mitocondrias o mi sistema digestivo en este momento. Mi comportamiento y mi identidad no dependen de que yo controle cómo hace la digestión mi estómago, aunque sin él, evidentemente, yo no existiría.

En el fondo, podríamos simplificar diciendo que los humanos somos un montón de átomos interactuando. Cuando esos átomos se juntan y de repente aparece un comportamiento súper complejo que no sabemos exactamente de dónde sale, los científicos lo llaman “propiedad emergente”.

Pues con los LLMs creo que pasa exactamente lo mismo.

El mecanismo básico (predecir la siguiente palabra) es un mecanismo simple y lo entendemos a la perfección. Lo que no entendemos es el comportamiento del sistema global. De la interacción de miles de millones de parámetros y operaciones matemáticas, surge una propiedad emergente.

No podemos desacreditar a la inteligencia artificial diciendo que es solo un “loro estocástico”, del mismo modo que no podemos desacreditar a un ser humano diciendo que es solo un saco de carne con chispazos eléctricos y neurotransmisores.

Hay que aceptar que en estos cacharros están apareciendo comportamientos que van mucho más allá de las piezas de código que los componen. Hay algo ahí, en esa emergencia, que todavía se nos escapa y que no somos capaces de entender del todo. Y a mí, francamente, me parece fascinante.